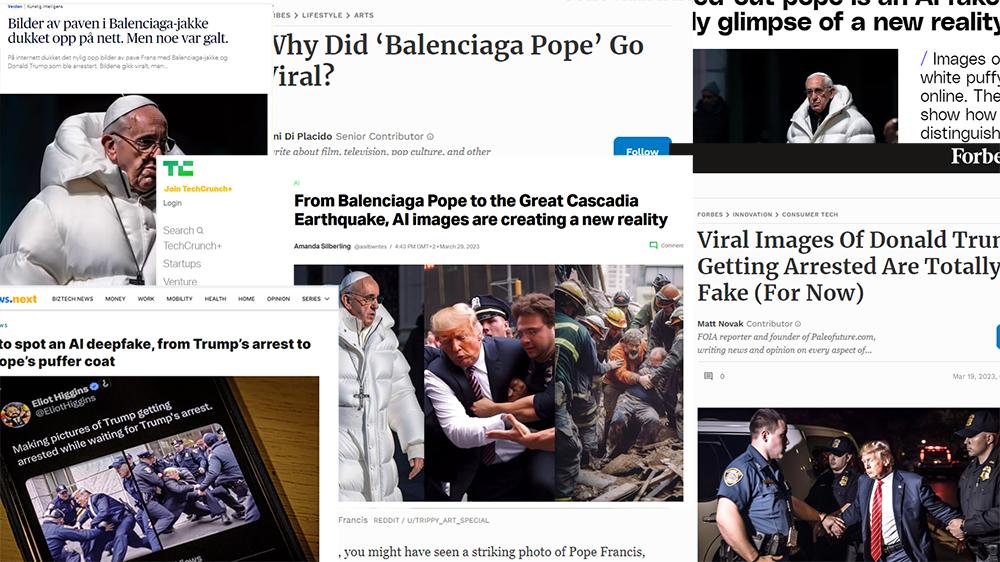

Rett f?r p?ske dukket det opp bilder av 86 ?r gamle Pave Frans i en stor hvit boblejakke fra motehuset Balenciaga. Omtrent samtidig gikk flere bilder av Donald Trump som ble arrestert av amerikansk politi viralt. Gjennom sosiale medier spredde de seg til publikum over hele verden.

Begge disse bildene var skapt av kunstig intelligens (AI), og er eksempler p? hvordan man i dag med enkle grep kan skape noe som ligner p? et fotografi. Er det et problem?

¨C Jeg tror ikke bildene p?virker mitt syn p? Donald Trump nevneverdig. Men problemet med denne type falskt innhold, er at selv om det ikke beskriver noe virkelig, s? p?virker det likevel v?rt syn p? virkeligheten n?r vi blir eksponert for det, sier Kristoffer Egeberg, ansvarlig redakt?r for faktasjekknettstedet faktisk.no.

Egeberg er gjest i podkasten Universitetsplassen, hvor han diskuterer bildene av Trump og paven med medieforsker Liv Hausken.

H?r episoden:

Fra ?deepfake? til AI-genererte bilder

Spol tilbake til 1990-tallet ¨C f?r sosiale medier. S? du et bilde, kunne du som oftest se hvilken TV-kanal eller avis som var avsender, og du kunne se hvilken dato det var publisert. Slik er det ikke lenger.

¨C I dag f?r mange informasjon og nyheter fra sosiale medier, som ikke har noen redakt?rplakat eller noe journalistisk ansvar. Dessuten gj?r videreformidlingen gjennom liking og sending at skillet mellom kildene viskes ut. Det er et genuint og grunnleggende problem ¨C som er nytt i dag, sier Hausken.

Falske nyheter ble for alvor satt p? agendaen etter Trumps valgkamp i 2016. Det tok ikke lang tid f?r bilder og video ble tatt i bruk for ? villede.

¨C Inntil nylig har mange snakket om ?deepfake?. Det er manipulerte bilder og videoer, hvor man klistrer et ansikt p? en skuespiller, og ogs? kan manipulere stemmen. Du kan f? dem til ? si hva som helst, mange har nok sett slike videoer med Barack Obama eller Donald Trump som sier de rareste ting, for eksempel, forklarer Egeberg.

Enda mer effektivt er en enklere manipulering.

¨C Med det som kalles ?cheapfake? bruker du virkelige bilder eller videoer, men tar dem helt ut av kontekst, eller manipulerer litt. Et kjent eksempel er en video av den amerikanske politikeren Nancy Pelosi hvor hastigheten er justert litt ned ¨C s?nn at det virker som at hun er full.

Det nyeste tilskuddet til floraen er bilder som de av paven i boblejakke og Trump med h?ndjern. Men var det egentlig s? mye bedre f?r?

Fotografier har blitt manipulert siden 1846

¨C Det er lett ? forenkle fotohistorien og si at f?r Photoshop, s? var alle bilder fotografisk genererte, og ingen hadde tuklet med noe som helst. Men det er feil, ganske enkelt, understreker Hausken.

Hun trekker historien om bildemanipulasjon s? langt tilbake som til 1846.

¨C Det eldste eksemplet p? et teknisk manipulert bilde jeg kjenner til er fra en britisk fotograf som reiste til Malta og lagde turistbilder. Han tok et bilde av fem munker, s? malte han over den ene p? negativet med blekk.

Hausken mener dette er uproblematisk ¨C og peker p? noe som er helt sentralt i vurderingen, nemlig hva som er bildets funksjon.

¨C Hvis bildet skal selges som en suvenir, er det kanskje ikke s? farlig hvor mange som var p? bildet da det egentlig ble tatt. Og det vil jo selge bedre om det er en god komposisjon enn om det er en d?rlig.

N?r skal pressen si stopp?

I oktober 2022 publiserte NRK en nyhetsoppdatering om str?mpriser (nrk.no), illustrert med et bilde av str?mmaster. Under bildet kunne man lese at det var ?generert av Midjourney (AI)?, alts? var det laget av kunstig intelligens. Det tok ikke mange timer f?r bildet var erstattet av et ?ekte? bilde ¨C et illustrasjonsfoto fra bildebasen NTB.

Det viste seg at bildet var publisert ved en feil, og i etterkant fulgte diskusjoner om retningslinjer rundt bruk av AI-genererte bilder i pressen. Saken har f?tt tilnavnet ?kabelgate? internt i NRK (journalisten.no).

¨C Jeg synes bildet kunne blitt st?ende som det var, sier Hausken.

Medieforskeren mener det ikke hadde v?rt et problem ? bruke et slikt bilde, s? lenge det hadde v?rt tydelig merket.

¨C Det problematiske er at n?r de erstatter det med et ekte bilde, s? er det fortsatt bare et bilde av noen master ¨C antagelig er det ogs? bearbeidet. Det burde da st?tt at det er et illustrasjonsbilde.

Det handler om hvilken funksjon bildet skal ha, og hvilken sjanger det plasserer seg i, p?peker Hausken, som ogs? understreker at dette vil kreve at mediene er systematiske i bruken av kunstige bilder.

Men Egeberg mener det stiller sv?rt h?ye krav til oss som ser bildene.

¨C Det legger opp til at folk flest er veldig bevisst p? disse ulikhetene og instinktivt skj?nner at dette er en illustrasjon, sier han.

Redakt?ren mener pressen m? holde seg unna innhold leget ved hjelp av kunstig intelligens.

¨C For oss som jobber i de redakt?rstyrte mediene, s? mener jeg at det m? v?re en absolutt grense. Vi m? i minst mulig grad manipulere virkeligheten, uten at det helt klart fremkommer hva det er man ser, og at konteksten er s? klar at man ikke er i tvil.

Manipulerte bilder fyller feeden

B?de Hausken og Egeberg ser tydelige utfordringer ved at man n? enkelt kan manipulere ekte fotografier, eller skape helt kunstige videoer og bilder. I privatlivet, s?rlig for ungdom, kan manipulerte bilder bidra til mobbing, skj?nnhetspress og personvernbrudd, mens i samfunnet for ?vrig peker de p? at bilder, selv slike som bare er ment som humor, kan oversv?mme offentligheten og svekke demokratiet.

Til deg som scroller hvilel?st nedover str?mmen av bilder og videoer p? Tiktok, Instagram eller Facebook har podkastgjestene noen gode r?d.

¨C Ikke del! Du kan se og korrumpere deg selv s? mye du vil, men tenk deg om f?r du deler det videre, sier Hausken.

H?r flere av gjestenes r?d for ? h?ndtere visuell desinformasjon, og hele diskusjonen om bildemanipulasjon f?r og n?, og hvem som har hvilket ansvar n?r fristelsen til ? lyve med bilder blir stor. Gjester er Kristoffer Egeberg og Liv Hausken. Programleder er Mari Lillesl?tten.

Om forskningen

Liv Hausken deltar i forskningsprosjektet Photofake, hvor forskere fra Universitetet i Oslo, H?yskolen Kristiana og Henie Onstad Kunstsenter utforsker de visuelle aspektene ved dagens desinformasjonskrise.

H?r flere episoder av Universitetsplassen

Universitetsplassen er en forskerbasert podkast om samfunnet produsert av Universitetet i Oslo.

Fake news, magiske myter og korrupsjon: Asias sterke ledere blir bare mektigere

Er teknogigantene i ferd med ? endre skolen?

Skjermen tar overh?nd ¨C hva skal foreldre gj?re?